El anuncio se hizo en el evento virtual Computex 2021 el 1 de junio, donde la compañía también lanzó NVIDIA Base Command Platform, un nuevo servicio de desarrollo alojado en la nube que ofrece a los clientes una forma de aprovechar los recursos de supercomputación de la empresa.

Los nuevos sistemas incluyen equipos basados en x86 de fabricantes de servidores de alto nivel, como Dell Technologies Inc, Hewlett Packard Enterprise Co, Lenovo Group Ltd, AsusTek Computer Inc y Super Micro Computer Inc, y también de empresas más pequeñas como Advantech Co. Ltd., Altos Computing Inc., ASRock Rack Inc., Gigabyte Technology Co. Ltd. y Quanta Cloud Technology Inc. Hay un amplio catálogo de opciones para diferentes niveles de precio y rendimiento, con los sistemas más potentes que ejecutan las GPU Tensor Core A100 de NVIDIA, y otros que incorporan sus GPU Tensor Core A40, A30 y A10.

Para los servicios más avanzados de entrenamiento de IA y computación en la nube, NVIDIA dijo que Dell, HPE, Supermicro y Nettrix Corp. están ofreciendo algunos de los primeros servidores basados en su plataforma de computación acelerada NVIDIA HGXTM. Según NVIDIA, estos sistemas ya están disponibles y cuentan con una selección de cuatro u ocho GPU A100 con interconexiones GPU NVLink y redes InfiniBand.

Algunos de los servidores anunciados hoy serán los primeros en integrar las nuevas unidades de procesamiento de datos BlueField-2 de NVIDIA, diseñadas para optimizar el rendimiento del hardware. Anunciadas el pasado mes de octubre, las DPU están diseñadas para gestionar gran parte de las tareas de administración de la infraestructura en los centros de datos, como el escaneo del tráfico de red en busca de malware y la orquestación del almacenamiento que, de otro modo, sería gestionado por las CPU.

“Los servidores que ejecutan principalmente redes definidas por software (por ejemplo, un balanceador de carga o un firewall distribuido), almacenamiento definido por software o aplicaciones empresariales tradicionales se beneficiarán de la capacidad de la DPU para acelerar, descargar y aislar las cargas de trabajo de la infraestructura para redes, seguridad y almacenamiento”, dijo el director de marketing de almacenamiento de NVIDIA, John Kim, en una entrada de blog. “Los sistemas que ejecutan VMware vSphere, Windows o soluciones de infraestructura hiperconvergente también se benefician de la inclusión de una DPU, ya sea que ejecuten aplicaciones de IA y aprendizaje automático, cargas de trabajo intensivas de gráficos o aplicaciones empresariales tradicionales.”

Los primeros sistemas que incorporan las DPU NVIDIA BlueField-2 estarán disponibles a finales de este año, según NVIDIA.

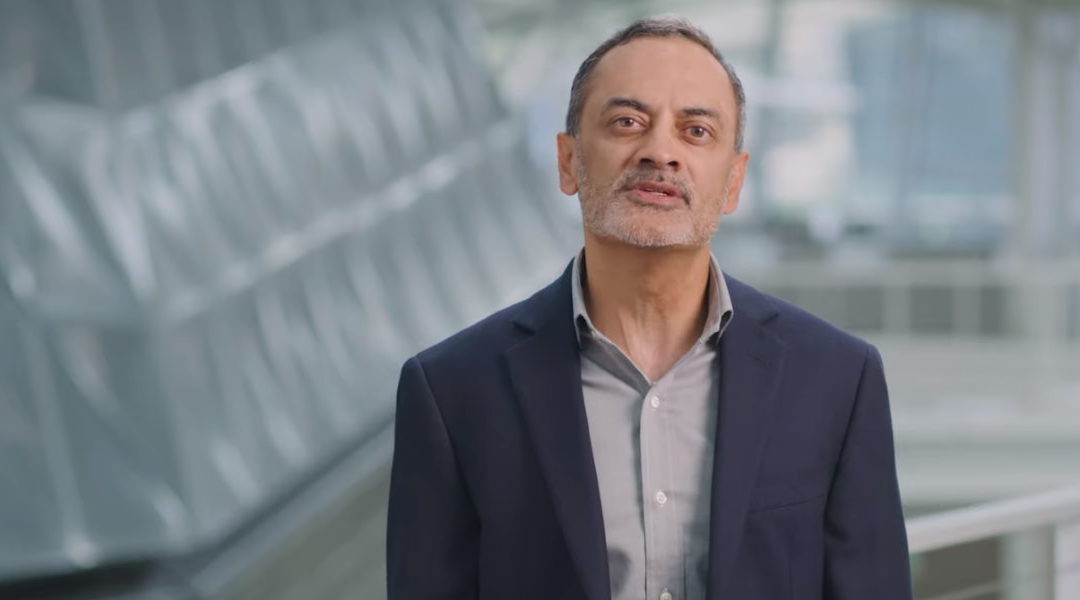

Ilustración: Fotograma, presentación de Manuvir Das, Head of Enterprise Computing, NVIDIA en Computex 2021, el 1 de junio. YouTube.